⚙️ ملخص تقني عن استخدام Grammarly للهوية بدون إذن

أطلقت شركة Grammarly ميزة جديدة تحمل اسم Expert Review تعتمد على الذكاء الاصطناعي لتقديم ملاحظات تحريرية مستوحاة من خبراء بارزين. تهدف الميزة إلى تعزيز جودة النصوص عبر استلهام آراء محللين معروفين في مجالات مختلفة. ومع ذلك، أثارت هذه الميزة جدلًا كبيرًا نظراً لاستخدام هويات بعض الشخصيات التقنية والإعلامية دون الحصول على إذن مسبق، مما أدى إلى مشكلات في الدقة ومصداقية المصادر.

يعرض هذا المقال تحليلاً هندسياً وتقنياً لخصائص الميزة، والتحديات التي تواجه نظم الذكاء الاصطناعي في محاكاة خبرات الأفراد، وما هي التأثيرات المحتملة على قطاع البرمجيات الهندسية.

🏗️ آلية عمل ميزة Expert Review في Grammarly

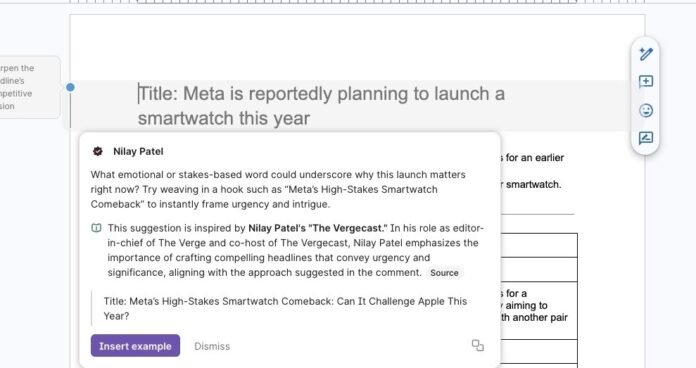

تعتمد الميزة على الذكاء الاصطناعي (AI) لتحليل نصوص المستخدمين واستخلاص مقترحات تحريرية مستوحاة من كتابات خبراء معروفين في تخصصاتهم. عندما ينقر المستخدم على زر “Expert Review” ضمن شريط أدوات Grammarly، يبدأ النظام في توليد توصيات مستمدة من تفسيرات وتحاليل مأخوذة من أعمال منشورة لهؤلاء الخبراء.

يُزعم أن النظام يقدم وجهات نظر “صناعية” ذات صلة بمحتوى النص، تشمل أسماء شخصيات مشهورة مثل:

- Stephen King

- Neil deGrasse Tyson

- Carl Sagan

بالإضافة إلى عدد من المحررين والصحفيين التقنيين المعروفين، مما يبدو أنه محاولة لتعزيز جودة النصح التحريري من خلال استنباط ذكي للأنماط الأسلوبية المختلفة.

🔧 المشكلات الفنية والأخلاقية في استخدام الهويات بدون إذن

واجهت ميزة Expert Review انتقادات بسبب تضمين أسماء شخصيات معروفة في مجال الصحافة التقنية، مثل رئيس تحرير The Verge وبعض الموظفين والسابقين، دون الحصول على إذن منهم.

تشمل المشكلات التالية:

- ظهور توصيات تحريرية مزيفة قد لا تعكس فعلياً أسلوب هؤلاء الخبراء أو توجهاتهم الحقيقية.

- تحديثات غير دقيقة لبعض التفاصيل الوظيفية لهؤلاء الخبراء، مما يشير إلى نقص في مراجعة البيانات أو الاتصال المباشر.

- روابط المصدر المصاحبة للتوصيات غالبًا ما تؤدي لمواقع غير موثوقة أو نسخ مؤرشفة ليست المصدر الأصلي، ما يحد من إمكانية التحقق الفني من صحة البيانات.

كل هذه المشكلات تشير إلى تحديات كبيرة في تطبيق تكنولوجيا الذكاء الاصطناعي خصوصًا فيما يتعلق بتوثيق المصادر واحترام الملكية الفكرية.

🌐 تحليل هندسي لواقعية تجسيد خبراء بتحرير النصوص

إن محاكاة أسلوب التحرير لشخص معين عبر الذكاء الاصطناعي تعتمد على استيعاب كميات كبيرة من محتوى ذلك الشخص المنشور، لكن هذه العملية تواجه قيودًا هندسية جوهرية:

- الذكاء الاصطناعي يحلل أنماط النصوص ولا يتعلم النية أو فلسفة التحرير الشخصية.

- يمكن أن ينتج النظام توصيات متضاربة مع أسلوب تحرير المراجع الفعليين؛ فقد يتم تقديم اقتراحات مكررة أو زائدة عن الحاجة.

- تحويل النصوص من أنماط متعددة إلى توصيات موحدة يتطلب نماذج عالية التعقيد ضمن نظم معالجة اللغة الطبيعية (NLP) التي لا تضمن دقة 100%.

فعلى سبيل المثال، تم تقديم توصية تحريرية من النظام تحمل اسم محرر معروف لكنها تتعارض مع أسلوبه التحريري الحقيقي المتبع في تبسيط الكلام وعدم التكرار.

🔌 التحديات التقنية في موثوقية مصادر الذكاء الاصطناعي

تعتمد عمليات الذكاء الاصطناعي على مصادر المعلومات المتوفرة عبر الإنترنت. ومع ذلك، أظهرت الميزة مشاكل في مصداقية المصادر وروابطها:

- توجيه المستخدمين إلى نسخ مؤرشفة أو بيانات غير أصلية.

- ربط نصوص التوصيات بأشخاص آخرين أو بعمل غير مرتبط بصاحب الهوية المعروضة.

- تعطيل أجزاء من الميزة بسبب أعطال متكررة أثناء استعراض المراجعات التفصيلية.

كل هذه النقاط تؤدي إلى تقليل ثقة المهندسين والكتاب في ميزة تعتمد على الذكاء الاصطناعي في تأمين مراجعة تحريرية موثوقة.

🏭 تأثيرات على قطاع البرمجيات الهندسية والتطوير التقني

قضايا مثل استخدام الهويات بدون إذن وحدود محاكاة أساليب التحرير تعكس تحديات أوسع تواجهها الشركات التي تطور أدوات AI والهندسة البرمجية، أبرزها:

- ضرورة تطوير آليات توثيق ذكية تضمن احترام حقوق الملكية الفكرية.

- تطوير خوارزميات تتفهم الفروق الدقيقة في الأساليب الشخصية للخبراء لتحسين دقة التوصيات.

- تعزيز قدرات نظم الذكاء الاصطناعي على توفير مصادر أصلية وموثوقة لتجنب الانزلاق في الروابط الاحتيالية أو غير الدقيقة.

هذا يشكل تحديًا هندسيًا وتقنيًا يتطلب نقاشاً مستمراً لتطوير المعايير الأخلاقية والفنية في الذكاء الاصطناعي.

🔍 خلاصة وتقنيات مستقبلية متوقعة

تُثبت تجربة ميزة Expert Review في Grammarly أن تطبيق الذكاء الاصطناعي في تحسين النصوص عبر استلهام “خبرات” حقيقية يواجه عدة عقبات تقنية وأخلاقية.

من الضروري للمطورين والمهندسين التركيز على:

- تطوير نماذج أكثر تعقيدًا لفهم وتوليد الأسلوب الشخصي بدقة.

- تحسين التحقق من صحة المعلومات والمصادر المرتبطة بالتوصيات.

- احترام الحقوق الفردية للخبراء عن طريق طلب الأذونات أو الاستعانة ببيانات مصرح بها.

بذلك يمكن أن يرتقي الذكاء الاصطناعي في مجال التعديل والتحرير إلى مستوى احترافي موثوق يدعم مهام الهندسة التقنية والصناعية بكفاءة عالية.